“缓存计费”上线,让大模型API使用更省、更快、更智能!

大模型API服务及时推出缓存计费功能,通过自动识别重复请求并返回缓存结果,降低用户使用成本。该功能已集成到现有系统中,无需修改调用方式即可使用。

为什么需要缓存计费?

在真实业务场景中,许多AI请求具有高度重复性:

比如客服系统中反复调用的常见问题解答、营销文案生成中的固定模板、前端智能提示的通用建议……

这些“重复劳动”本不该每次都支付全额推理费用!

而且,问答场景中都是多轮对话,随着对话次数的增加,历史数据会越积越多,传入大模型的输入数据就会越大,推理费用就会越高。

现在,有了缓存计费:能省下的,咱们一分都不多花。

什么是“缓存计费”?

1. 自动缓存

- 系统自动对每个请求进行缓存处理

- 使用标准化的/chat/completions接口,无需添加任何额外参数

- 缓存基于请求内容(包括prompt、模型参数等)生成唯一标识

2. 缓存命中与计费

- 缓存命中:当系统检测到相同请求时,直接返回缓存结果

- 计费方式:

- 命中缓存:仅收取缓存读取费(低于输入token价格)

- 未命中缓存:按原有规则收取输入+输出Token费用

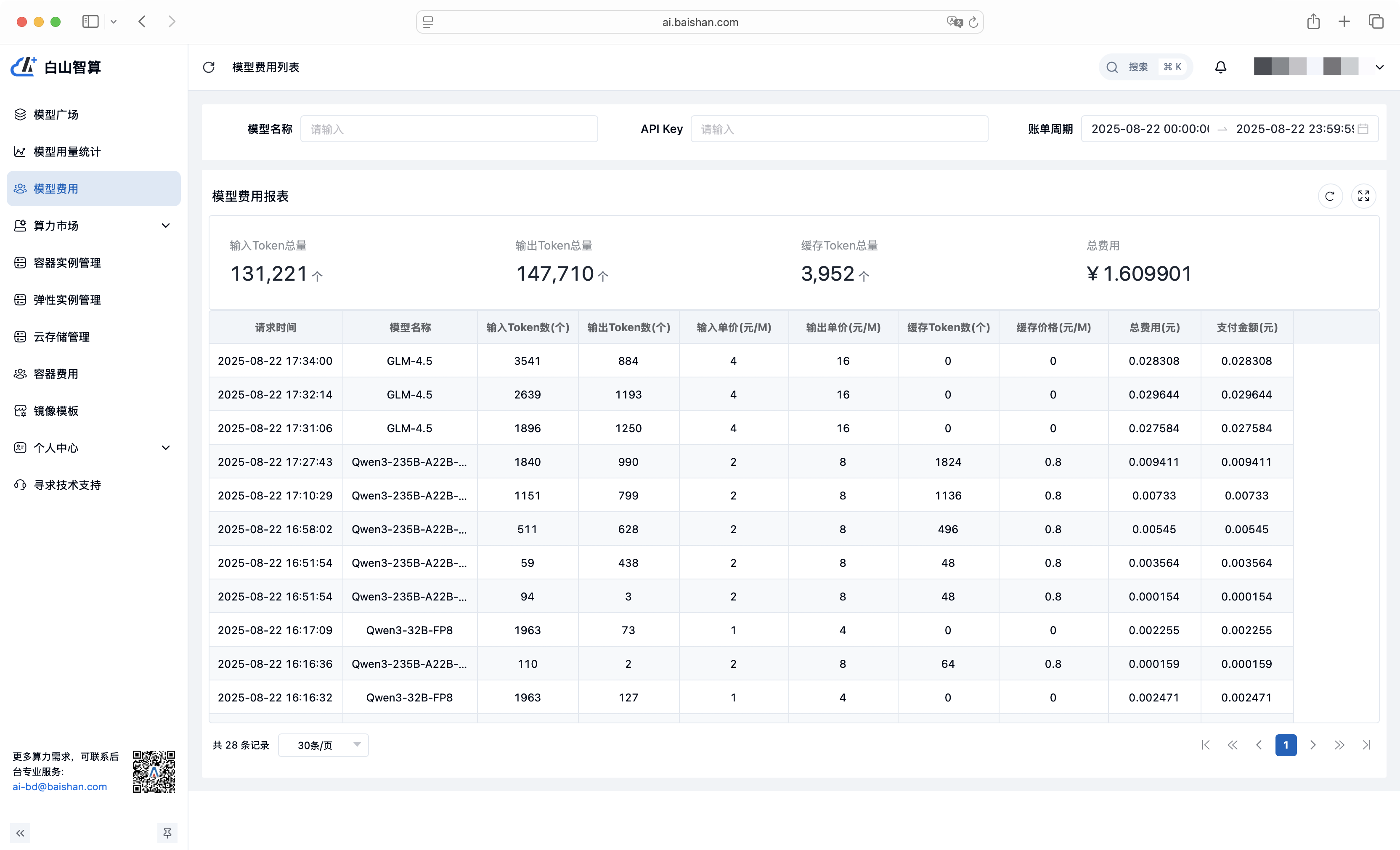

缓存计费金额在哪查询

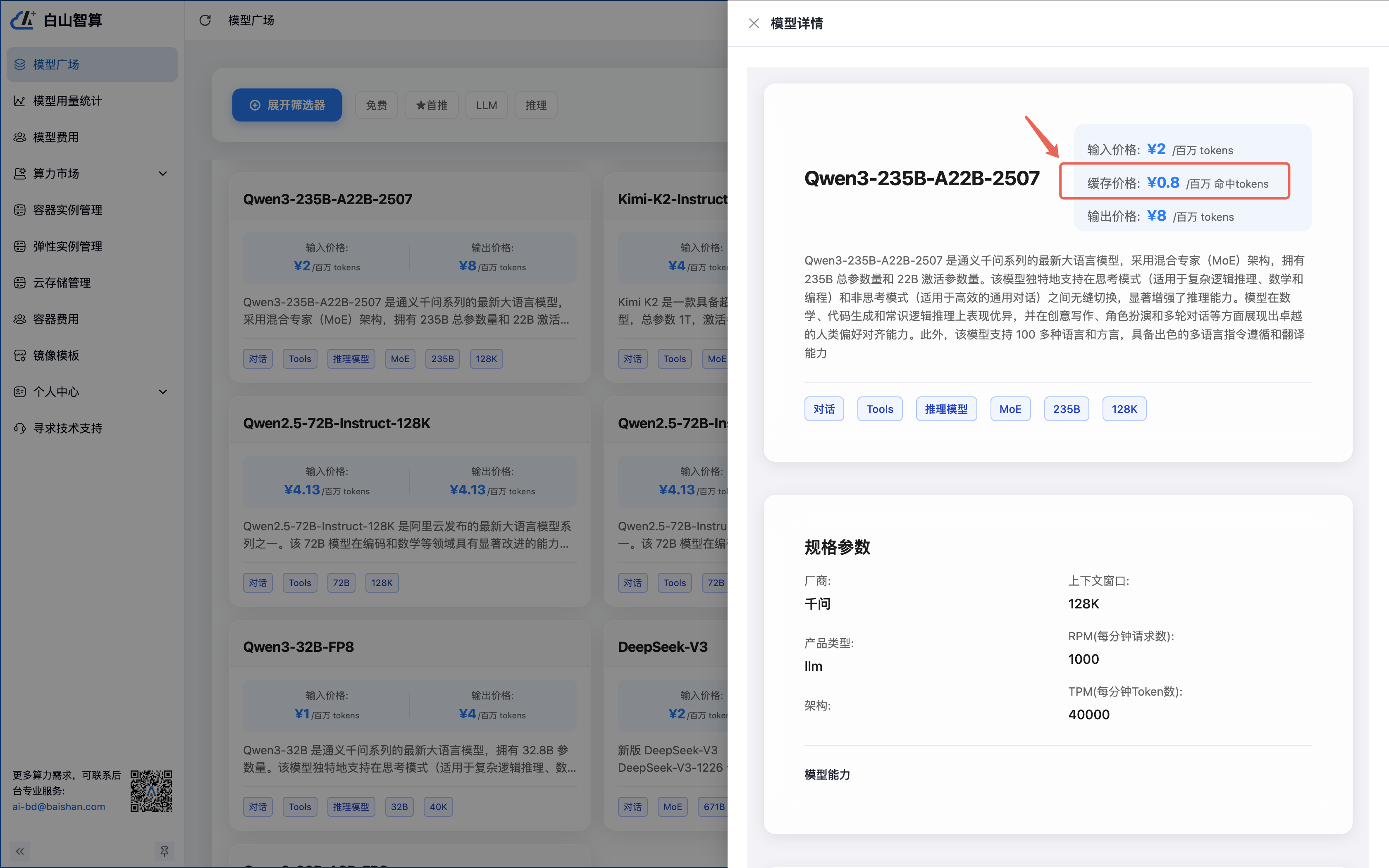

当前支持缓存计费的模型不多,具体可以在算力平台的模型详情中查看

当模型费用中出现缓存价格时,该模型使用过程中就会自动享受缓存带来的优惠

无需变更原有API调用:

http

POST /chat/completions

Authorization: Bearer <API_KEY>

Content-Type: application/json

{

"model": "Qwen3-235B-A22B-2507",

"messages": [

{"role": "user", "content": "用一句话介绍人工智能。"}

],

"temperature": 0.7,

"max_tokens": 128000

}计费变化对比

注:示例成本仅供参考,实际费用根据不同模型的不同Token使用量计算